L'IA dans la com des collectivités : entre opportunités et vigilance

L’intelligence artificielle n’est plus une promesse lointaine ni un sujet réservé aux experts. Elle est désormais une réalité quotidienne dans les collectivités territoriales, et plus encore dans les services communication. Entre enthousiasme, interrogations éthiques et besoin urgent de cadres clairs, la table ronde sur l’IA au dernier Forum Cap'Com a permis de dresser un état des lieux lucide et chiffré de l’usage de l’IA dans les collectivités, tout en ouvrant des pistes concrètes pour les communicants publics.

Article rédigé par Hugo Singrajphakd et Nathan Renault, étudiants en master 2 de communication publique et politique à l’UPEC, sur le Grand angle « L'IA dans sa communication : entre prudence et audace » du Forum Cap'Com d'Angers, animé par Pierre Bergmiller, responsable de la communication numérique de l'eurométropole de Strasbourg, et Marc Cervennansky, responsable de la communication numérique de Bordeaux Métropole, avec les interventions de Jacques Priol, président du cabinet Civiteo, expert data & IA, auteur et conférencier, et Laura Bokobza, sparring partner, fondatrice de LBk Consulting, ambassadrice du plan national « Osez l’IA ».

Une adoption massive… mais encore largement hors cadre

Premier constat selon Marc Cervennansky : nous sommes à un point de bascule sur l’usage de l’IA et il faut se poser les bonnes questions.

Un sondage réalisé au début de la conférence révèle que 83 % des communicants présents utilisent aujourd’hui l’IA à titre professionnel. Un chiffre en forte progression par rapport à ceux des sondages similaires menés les années précédentes, qui confirme que les métiers de la communication sont parmi les plus avancés en matière d’adoption de l'IA.

Mais cette diffusion rapide masque une fragilité majeure : seuls 18 % des répondants déclarent disposer d’un cadre d’usage clairement posé dans leur collectivité. Autrement dit, l’immense majorité des usages se développent aujourd’hui de manière informelle, individuelle, parfois invisible pour les directions ou les élus.

Cette situation crée un paradoxe : l’IA est utilisée quotidiennement, parfois de manière stratégique, sans doctrine commune, sans règles partagées, et sans clarification des responsabilités.

Observatoire Data Publica : des chiffres clés qui confirment le basculement

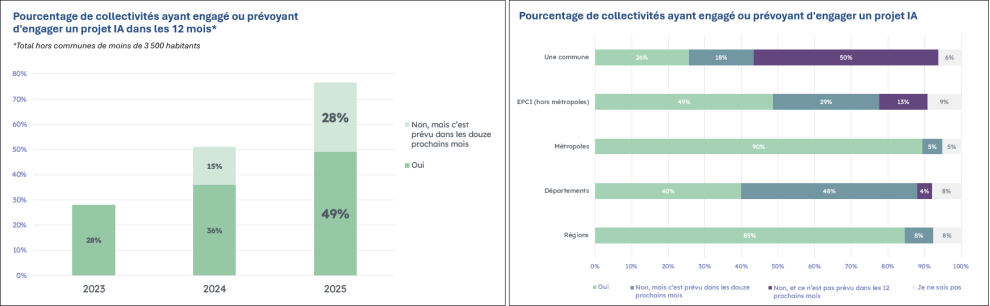

Les résultats du Baromètre 2025 de l’Observatoire Data Publica, présentés par Jacques Priol, viennent objectiver cette bascule.

Ainsi, en 2025, près de 49 % des collectivités territoriales ont déjà commencé à tester l’IA, toutes tailles confondues, y compris de très petites communes. Près de 28 % supplémentaires déclarent vouloir s’y engager dans les prochains mois, ce qui laisse entrevoir un horizon proche où 3 collectivités sur 4 utiliseront l’IA. En 2024, elles n’étaient que 36 % à avoir franchi le pas et 15 % à vouloir le franchir : la progression est donc spectaculaire et rapide.

Ce baromètre apporte aussi un enseignement important : tous les métiers sont concernés. Si les premières applications concernaient surtout les fonctions urbaines (gestion de l’eau, de l’énergie, des déchets, de la mobilité), l’IA progresse fortement dans l’administration et la gestion interne, la relation aux usagers, des domaines qui concernent les communicants publics. Une évolution très rapide due à la diffusion des outils génératifs comme ChatGPT, ou intégrés à des systèmes comme Copilot ou Mistral.

L'usage de l'IA générative a d'ailleurs fortement progressé dans les collectivités, passant de 52 % à 84 %, et ce à toutes les échelles, même dans les plus petites communes (89 % des communes). Jacques Priol insiste cependant sur les autres formes d’IA utilisées pour la mise en place et l’évaluation des politiques publiques par de l’apprentissage machine (machine learning).

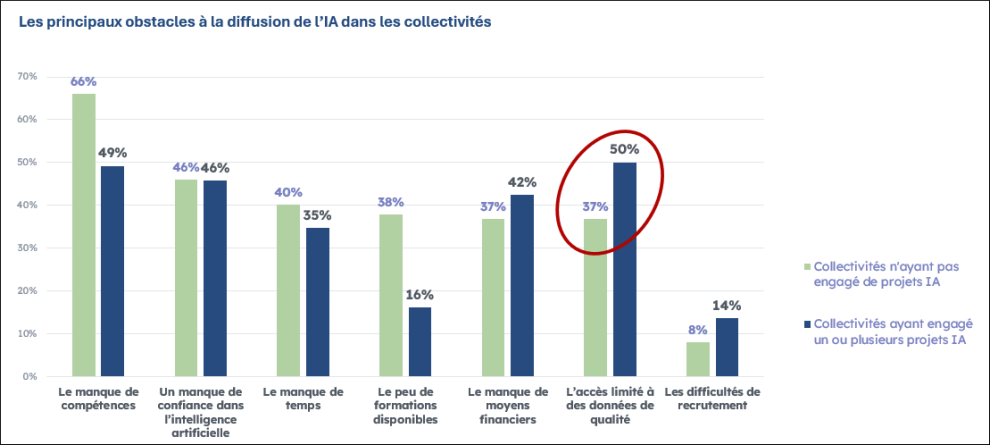

Confiance, données, hallucinations : les mêmes doutes chez les pionniers

Contrairement à une idée reçue, les collectivités qui ont déjà expérimenté l’IA ne sont pas plus confiantes que les autres. Le baromètre révèle que 46 % des collectivités, qu’elles aient commencé ou non, expriment une méfiance vis-à-vis de la fiabilité des systèmes d’IA.

Pour les collectivités n’ayant pas encore testé, la crainte principale porte surtout sur les erreurs, la fabrique d’information, la désinformation. Alors que du côté des collectivités plus expérimentées, la méfiance est plus évidente : elles ont identifié les limites réelles des outils, la nécessité d’une supervision humaine permanente, et les risques liés à des données mal organisées ou obsolètes. Cependant, un point revient avec insistance : l’IA ne vaut que par la qualité des données qu’on lui fournit. Sans orchestration préalable des données territoriales, sans mise à jour continue, les promesses de performance se transforment rapidement en déceptions. Jacques Priol explique par exemple n’avoir vu aucun chatbot territorial convaincant au-delà de trois ou quatre questions. Car, lorsqu'on met à jour des informations erronées sur le site web de sa collectivité, le chatbot entraîné sur les données initiales doit d'abord désapprendre ce qu'il a appris auparavant. Au mieux, le chatbot renverra vers le standard de la collectivité, au pire il donnera une information erronée.

Communication publique : le métier le plus exposé… et le plus transformé

Pour Jacques Priol, le métier de communicant est celui où le taux d’usage de l'IA est le plus élevé, où les gains de productivité potentiels sont les plus visibles mais aussi celui où les risques symboliques, éthiques et politiques sont les plus forts. Voyons plus concrètement les impacts sur l'activité du communicant à travers quatre cas d'usage de l’intelligence artificielle générative en communication publique repérés par Pierre Bergmiller.

Générer des images pour les publications

Pour :

- se libérer du problème du droit à l’image ;

- économiser des frais de prises de vues ;

- produire dans des délais ultra-courts.

Points d'attention :

- mentionner explicitement l'usage de l'IA sur le support ;

- images de personnes qui n’existent pas ;

- impact écologique ;

- course à la productivité.

Générer des publications pour les réseaux sociaux

Pour :

- varier les styles, les tons ;

- trouver de nouvelles pistes éditoriales ;

- adapter les posts aux différents réseaux sociaux.

Point d'attention :

- n’est pas toujours considéré comme productif finalement.

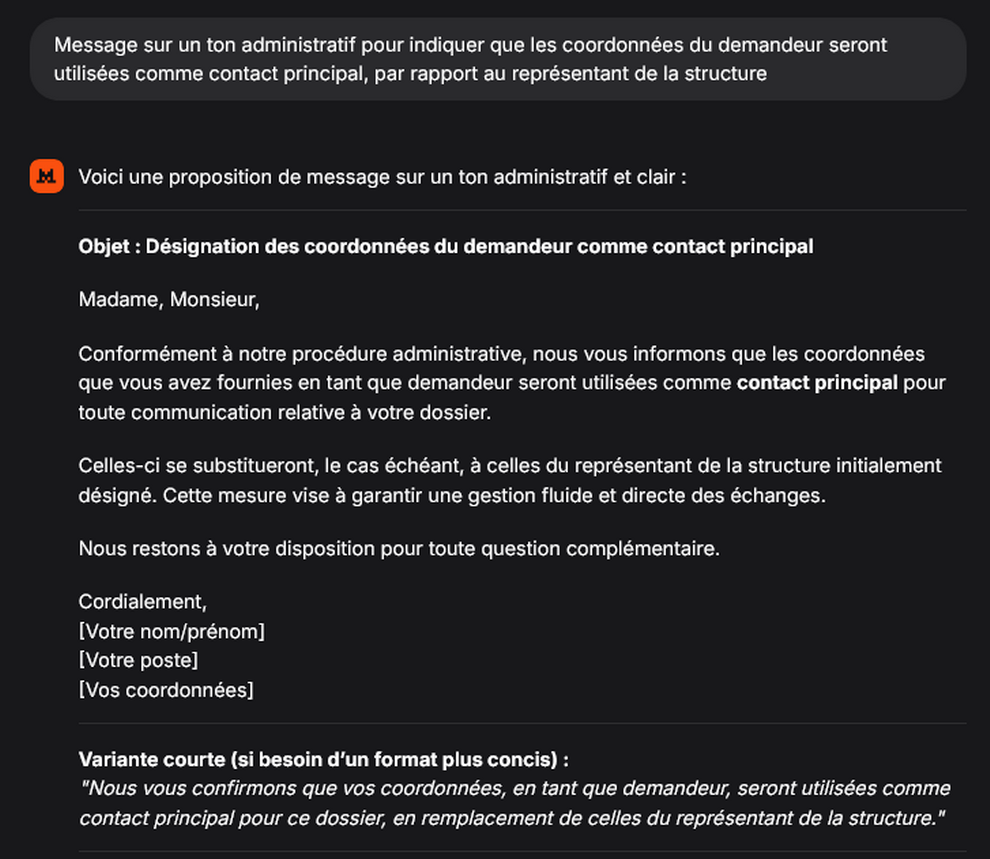

Reformuler les étapes d’une démarche en ligne avec ChatGPT ou Mistral

Pour :

- faciliter la compréhension de textes techniques, jargonneux, fournis par les services ;

- supprimer les termes superflus.

Points d'attention :

- relecture et vérification par le service métier indispensable ;

- rester vigilant sur la confidentialité des contenus.

Intégrer un chatbot dans un site web

Pour :

- soulager les autres canaux (accueil, téléphone, mail) ;

- identifier les sujets les plus demandés ;

- avoir une disponibilité 24h/24, 7j/7.

Points d'attention :

- risques d’erreurs, d’hallucinations et de biais à limiter ;

- vigilance sur la confidentialité des données ;

- expérience utilisateur possiblement frustrante.

Pour Pierre Bergmiller, ces usages de l'IA révèlent des tensions nouvelles : la quête de gains de productivité nous pousse à nous interroger sur nos propres limites, tandis que se posent simultanément les enjeux de l’uniformisation des contenus, de la préservation de la confiance des usagers et de l’assomption pleine et entière de la responsabilité des messages produits avec l’aide de l’intelligence artificielle.

Le chatbot d’Air Canada a par exemple annoncé des promotions inexistantes, obligeant la compagnie à dédommager un usager, illustre Laura Bokobza. Elle met en garde contre les hallucinations des IA, soulignant que ce type de scandale pourrait être bien plus grave pour des services publics.

Des gains de productivité à nuancer

Près de 85 % des marketeurs qui utilisent l’IA dans le privé disent gagner moins de 208 heures par an (cinq semaines), précise Laura Bokobza. Un chiffre qui n’est pas non plus révolutionnaire pour l'experte, qui nuance ces gains de productivité promis par l'IA. Faire un visuel est rapide, certes, mais derrière, le raisonnement sur la cible, la façon dont on la touche et on lui apporte quelque chose, restent des compétences humaines et difficilement calculables pour les IA.

Transparence, droit et éthique : des lignes rouges à ne pas franchir

Dans le secteur public, l’IA ne peut effectivement pas être vue comme un simple outil dont on pourrait disposer librement, sans réglementation. Les collectivités sont donc soumises à une obligation constitutionnelle de transparence (art. 15 de la Déclaration des droits de l’homme et du citoyen), rappelée par la jurisprudence récente : il est interdit d’utiliser des systèmes opaques pour des décisions individuelles, ou des algorithmes capables de modifier seuls leurs règles (Conseil constitutionnel, décision n° 2018-765 DC du 12 juin 2018 § 71).

Cette exigence s’applique aussi à la communication :

- transparence sur l’usage de l’IA ;

- clarté vis-à-vis des citoyens ;

- vigilance pendant les périodes électorales ;

- respect du droit d’auteur, du droit à l’image et des règles de la commande publique.

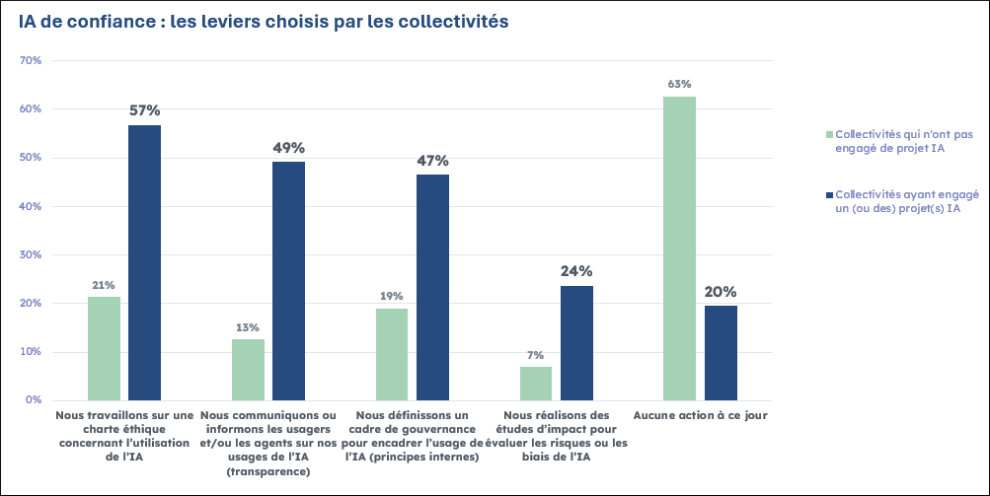

À ce titre, 57 % des collectivités ayant commencé à tester l’IA travaillent aujourd’hui à un document d’encadrement : charte, doctrine, cadre d’usage, parfois soumis au vote des élus. À noter que depuis le 1er janvier 2025, les communes de plus de 50 000 habitants doivent aussi se doter d’une stratégie numérique responsable.

Vers des cadres d’usage métiers, et non plus seulement techniques

Face à cette généralisation rapide des usages, une limite se manifeste clairement dans les cadres existants, majoritairement techniques ou juridiques, qui ne suffisent plus à encadrer les pratiques. Les doctrines portées par les directions du numérique ou des systèmes d’information ont permis de poser des principes structurants (sécurité, conformité, protection des données) mais elles laissent en suspens une question importante. Comment l’IA s’intègre-t-elle concrètement dans le travail quotidien des communicants publics ? Il est désormais nécessaire de décliner des cadres d’usage métier par métier, et non plus uniquement à l’échelle globale de la collectivité. Une déclinaison qu'engage la direction de la communication de l'eurométropole de Strasbourg, où Pierre Bergmiller travaille à la définition de ces cadres d'abord avec les chargés de com, puis l'équipe numérique, les attachés de presse, l'équipe de production éditoriale, etc.

La communication est en effet un champ d’application particulièrement exposé. Elle touche à la production de contenus visibles, à la relation de confiance avec les usagers, à l’image de l’institution et à la responsabilité politique. Cela suppose de clarifier des règles opérationnelles là où, jusqu’ici, dominaient l’expérimentation individuelle et l’implicite. Il s’agit notamment de définir :

- ce qui peut relever d’un usage courant de l’IA (assistance à la reformulation, vulgarisation de contenus complexes, aide à l’analyse ou à la production de premières versions) ;

- ce qui doit rester proscrit ou strictement encadré (contenus engageant juridiquement la collectivité, informations non vérifiées, manipulation de données sensibles, visuels pouvant induire en erreur) ;

- les modalités de validation humaine et de responsabilité éditoriale ;

- les exigences de transparence vis-à-vis des usagers ;

- ainsi que les conditions à poser dans les relations avec les agences et prestataires, afin d’éviter que l’usage de l’IA ne se fasse « hors champ » de la commande publique.

L’enjeu n’est pas de ralentir ou de brider les pratiques, mais plutôt de leur donner un cadre clair, partagé et assumé, permettant aux communicants de travailler en sécurité, sans déplacer sur les individus des risques qui relèvent de choix collectifs et politiques.

Une boussole plutôt qu’un mode d’emploi

Au-delà des règles et des outils, les échanges ont fait émerger l’idée forte que l’IA ne se pilote pas comme un simple logiciel. Elle ne se réduit ni à une promesse de performance automatique, ni à une menace qu’il faudrait contenir à tout prix. Son arrivée agit surtout comme un révélateur des tensions déjà à l’œuvre dans les organisations publiques.

Pour les communicants, l’IA renvoie directement aux fondamentaux du métier : produire du sens, contextualiser l’information, adapter le message aux publics, assumer une responsabilité éditoriale. Là où la technologie accélère la production, elle oblige paradoxalement à ralentir la réflexion : pourquoi ce message, pour qui, dans quel cadre, avec quelles conséquences ?

Les discussions ont également mis en exergue des questions qui dépassent largement la sphère de la communication : l’organisation du travail, la répartition des tâches, la gestion du temps « gagné », l’évolution des compétences, le rôle du management dans la supervision de systèmes non humains, ou encore les impacts sur la qualité de vie au travail. Autant de sujets sur lesquels l’IA n’apporte pas de réponse clé en main, mais impose de nouveaux arbitrages.

Dans ce contexte, les participants ont davantage évoqué la nécessité d’une boussole que celle d’un mode d’emploi exhaustif. Une boussole qui articule éthique, stratégie et professionnalité, qui aide à prendre des décisions dans l’incertitude, et qui rappelle que, dans le service public, la technologie reste subordonnée à des valeurs : l’intérêt général, la transparence, la confiance et la responsabilité. En ce sens, Pierre Bergmiller, Marc Cervennansky et Estelle Dumout, consultante en stratégie éditoriale, communication numérique et intelligence artificielle, ont proposé et élaboré avec un groupe de professionnels de la communication publique la boussole de l'IA, un cadre de réflexion évolutif à l'usage des directions de la communication pour poser leurs propres cadres de production de contenus éditoriaux, graphiques ou audiovisuels.

À l’heure où les usages de l’IA deviennent un réflexe pour de nombreux citoyens, cette capacité à se positionner clairement apparaît comme un enjeu central pour la communication publique. Non pas suivre aveuglément l’innovation, mais l’intégrer de manière consciente, lisible et cohérente avec la mission de service public.